中華民國影像處理與圖形識別學會 ( IPPR ) 自民國79年成立以來,致力於電腦視覺、圖學與影像處理相關領域學術與經驗的交流,已經成為國內最重要的電腦視覺、圖學與影像處理相關領域的交流場所。今年(2016)學會舉辦第二十九屆電腦視覺、圖學與影像處理研討會 (以下簡稱 CVGIP 2016 ),清華電機系孫民教授所帶領的研究生團隊榮獲2016優良論文獎與Digital Drift Best Paper on Deep Learning for Visual Analysis金獎與銀獎,幾乎囊括所有重要獎項,成績表現斐然。

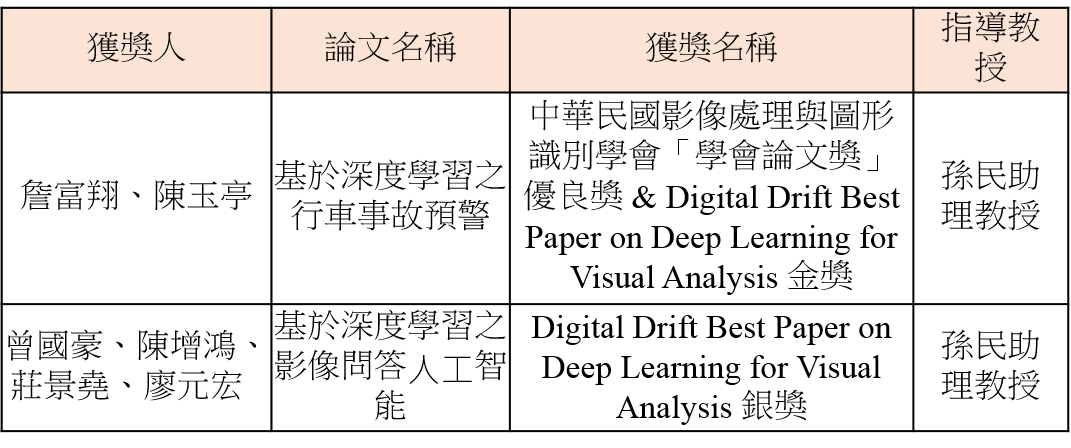

CVGIP 研討會每年吸引各界從事電腦視覺、圖學、影像與多媒體處理等相關方面的專家學者及業界先進、研究生報名參加,交換研究心得與產學經驗,獲獎者均為電腦視覺、圖學與影像處理領域之精英!清華電機碩士班詹富翔、陳玉亭團隊和曾國豪研究生、陳增鴻研究生、莊景堯學士班學生、廖元宏學士班學生團隊,分別奪下中華民國影像處理與圖形識別學會「學會論文獎」優良獎 & Digital Drift Best Paper on Deep Learning for Visual Analysis 金獎和Digital Drift Best Paper on Deep Learning for Visual Analysis 銀獎,表現亮眼,評審團給予高度肯定。(以下為獲獎組別名單) :

獲得【「學會論文獎」優良獎 & Digital Drift Best Paper on Deep Learning for Visual Analysis 金獎】獎的詹富翔同學表示,目前所提出的深度學習模型(Dynamic-Spatial-Attention (DSA) Recurrent Neural Network (RNN))來預測行車紀錄器中的車禍時間點,我們的模型能夠學習到(1) 在一個時間點上的場景中哪個物體可能會比較危險並特別注意那幾個物體 (2) 並分析上下的時間點來觀察比較危險的物體有沒有可能發生車禍。預測車禍不像是預測行車行為(Ex :切換道路、轉彎)那麼簡單就能分析,因為車禍都是很突然的發生而且在路上不常發生,所以我們利用(1)最先進的物體偵測的演算法(Faster-RCNN)來偵測物體 (2)並利用場景、物體的外觀和軌跡的資訊來預測車禍時間點。我們收集了678部有發生不同形式的車禍(Ex:機車撞機車、汽車撞機車…等)的台灣行車紀錄影片,並且每部影片都有標註發生車禍的時間點以及發生車禍的物體種類,所以我們可以利用這些資料來做監督式學習訓練並量化訓練後的結果。利用我們提出的模型能夠在大概兩秒前會有80% recall和56.14% precision而且能夠達到最高74.35% mean average precision。

清華電機詹富翔(右)與陳玉亭研究生奪下中華民國影像處理與圖形識別學會「學會論文獎」優良獎 & Digital Drift Best Paper on Deep Learning for Visual Analysis 金獎,評審給予高度肯定。圖為詹富翔同學(右)代表獲頒獎項。

獲【Digital Drift Best Paper on Deep Learning for Visual Analysis 銀獎】的陳增鴻同學表示,我們提出了一個可巨量化(scalable)

清華電機陳增鴻研究生(右)團隊榮獲Digital Drift Best Paper on Deep Learning for Visual Analysis 銀獎,表現亮眼。

深度學習是近來電腦視覺與機器學習之重要技術之一,其對於相關領域之效能與應用有突破性之演進與貢獻。中華民國影像處理與圖形識別學會 ( IPPR )希望透過研討會的舉辦,除了有論文口頭討論及廠商展示外,並將邀請國內外知名專家學者做專題演講,探討當前電腦視覺、圖學、影像與多媒體處理等相關領域的重要趨勢。此次CVGIP 2016匯聚各界專家與年輕學子,共同分享影像、媒體處理的研究成果,帶動台灣未來創新研發最重要的力量。